Các bước dùng AI Stable Diffusion vẽ ảnh nhân vật đồ họa

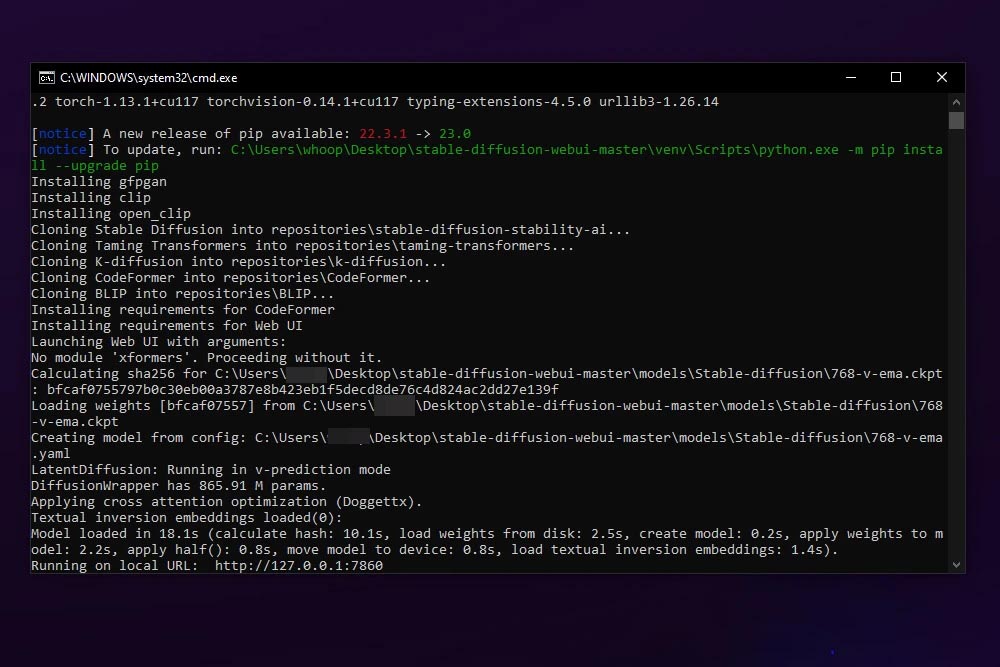

Cài đặt AI Stable Diffusion

Hiện nay, để cài đặt Stable Diffusion, người dùng có thể lựa chọn giữa hai phương pháp: cài đặt trên PC hoặc sử dụng Google Colab. Bạn có thể tham khảo một số video hướng dẫn trên Youtube

Tuy nhiên, để đạt hiệu suất tốt nhất của AI Stable Diffusion, người dùng nên ưu tiên sử dụng Google Colab, bởi nó cung cấp tài nguyên miễn phí và đủ dùng, giúp tránh những trục trặc có thể xảy ra khi sử dụng máy tính yếu. Với bộ nhớ RAM lên tới khoảng 13GB và VRAM hay GPU lên tới 15GB, Google Colab sẽ là sự lựa chọn lý tưởng để sử dụng AI Stable Diffusion một cách hiệu quả.

Dùng Controlnet và điều chỉnh các thông số phù hợp

Trước khi sử dụng AI Stable Diffusion để vẽ ảnh nhân vật đồ họa, bạn cần biết các khái niệm sau:

- ControlNet: cách để AI vẽ một bức tranh đẹp từ bản vẽ tay và giữ các chi tiết của nó.

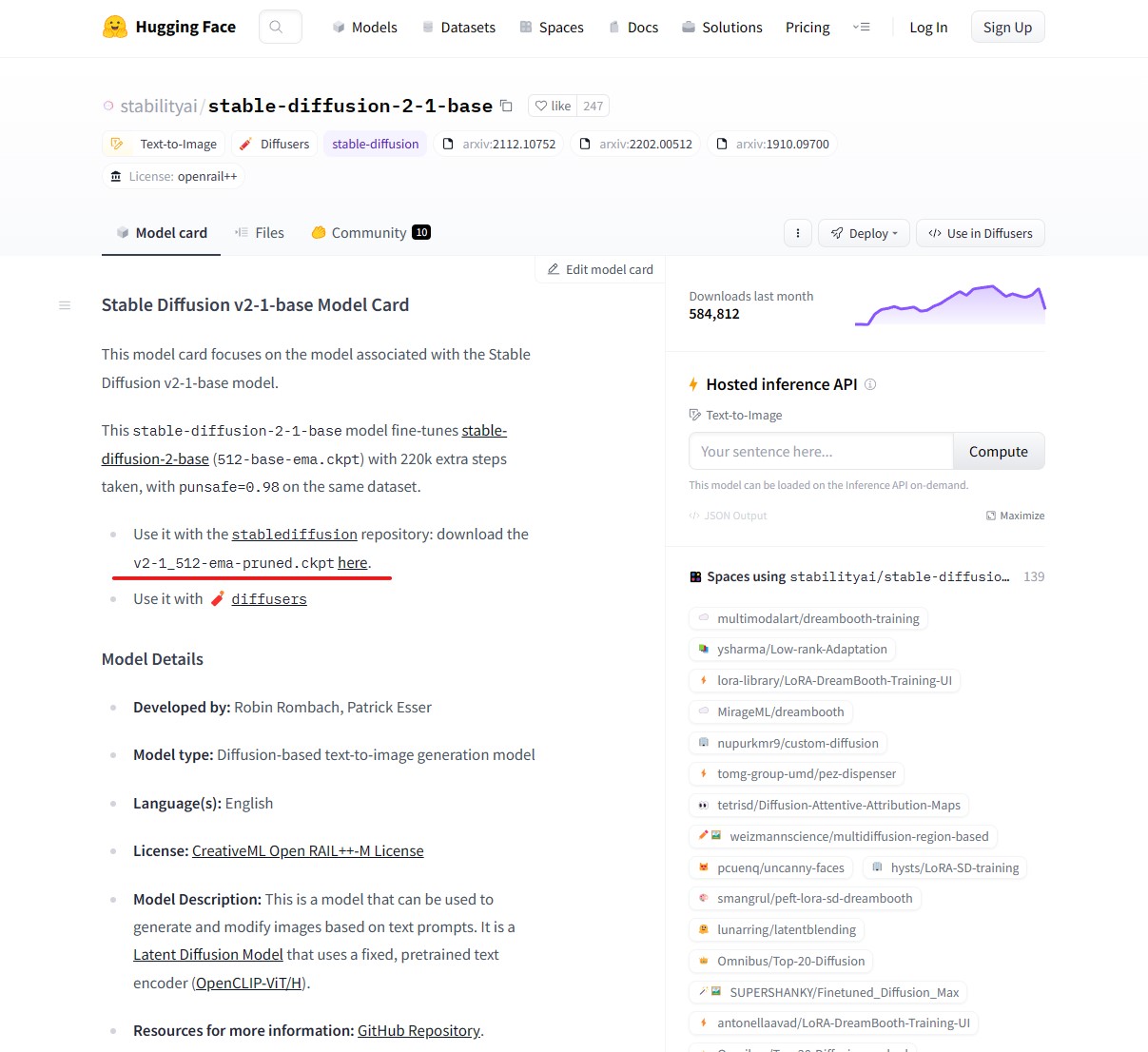

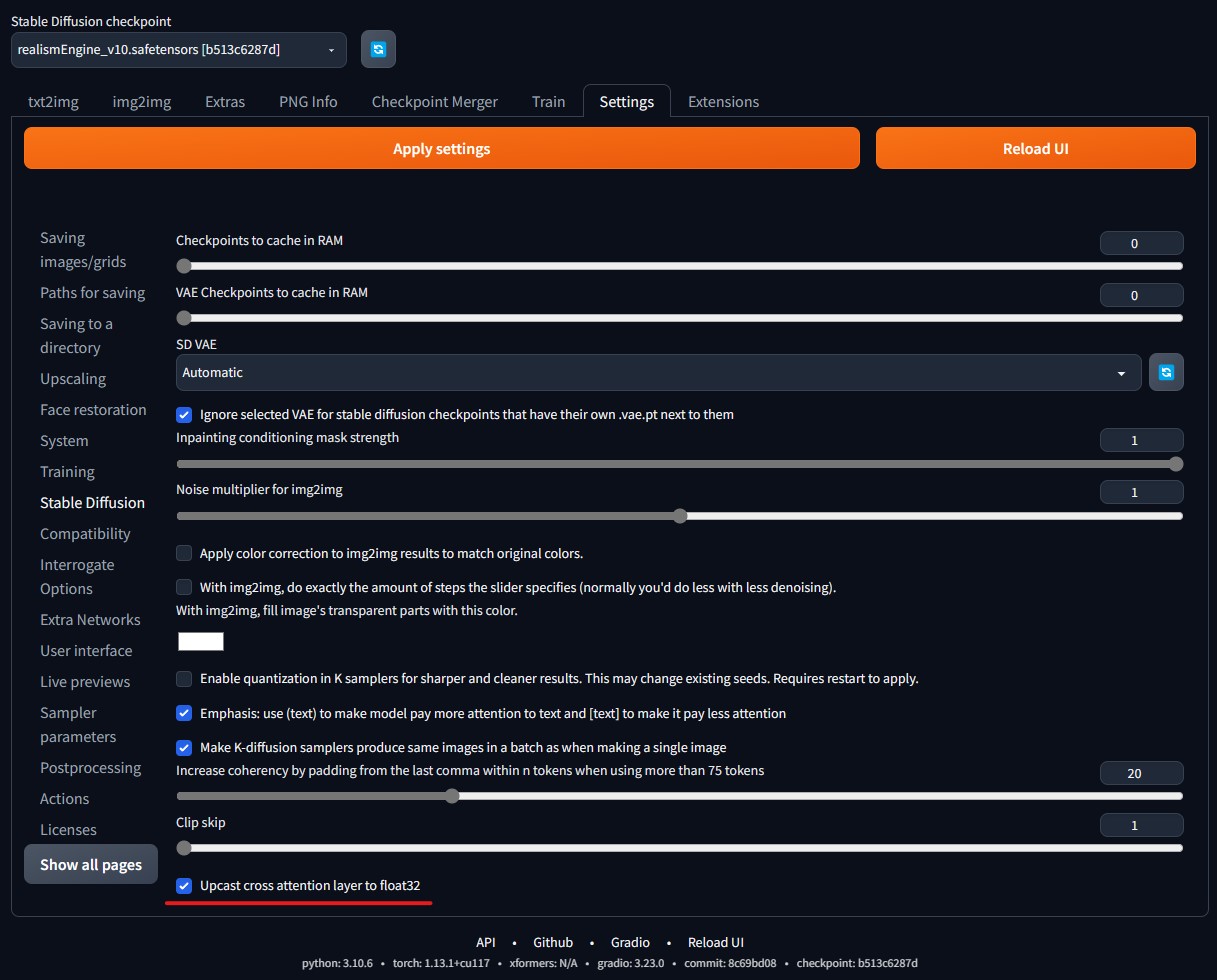

- Model (Checkpoint): AI được train từ một bộ dữ liệu lớn và được sử dụng để tạo ra ảnh.

- Lora: phương pháp fine-tune model hoặc thay đổi phong cách ảnh.

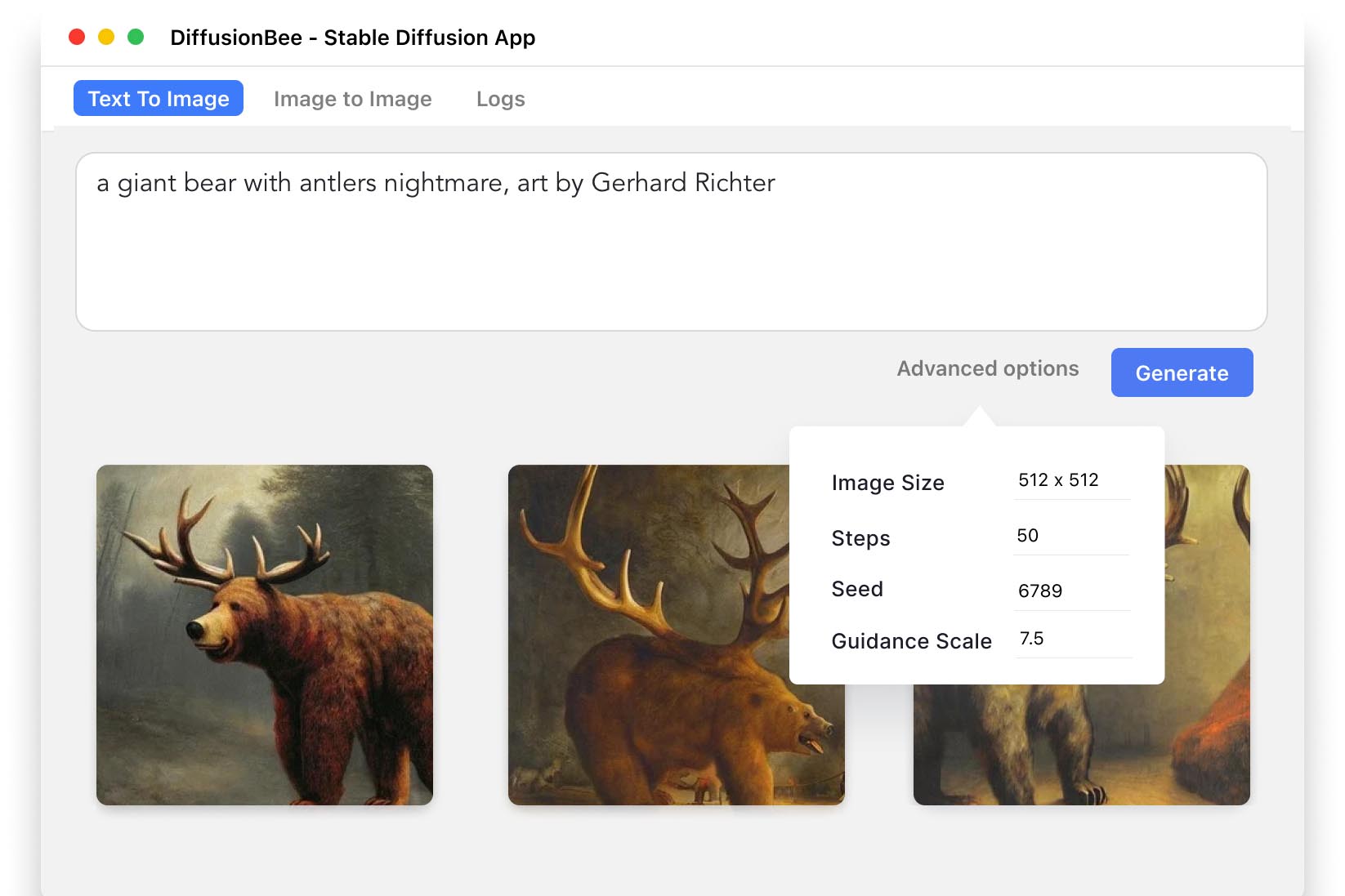

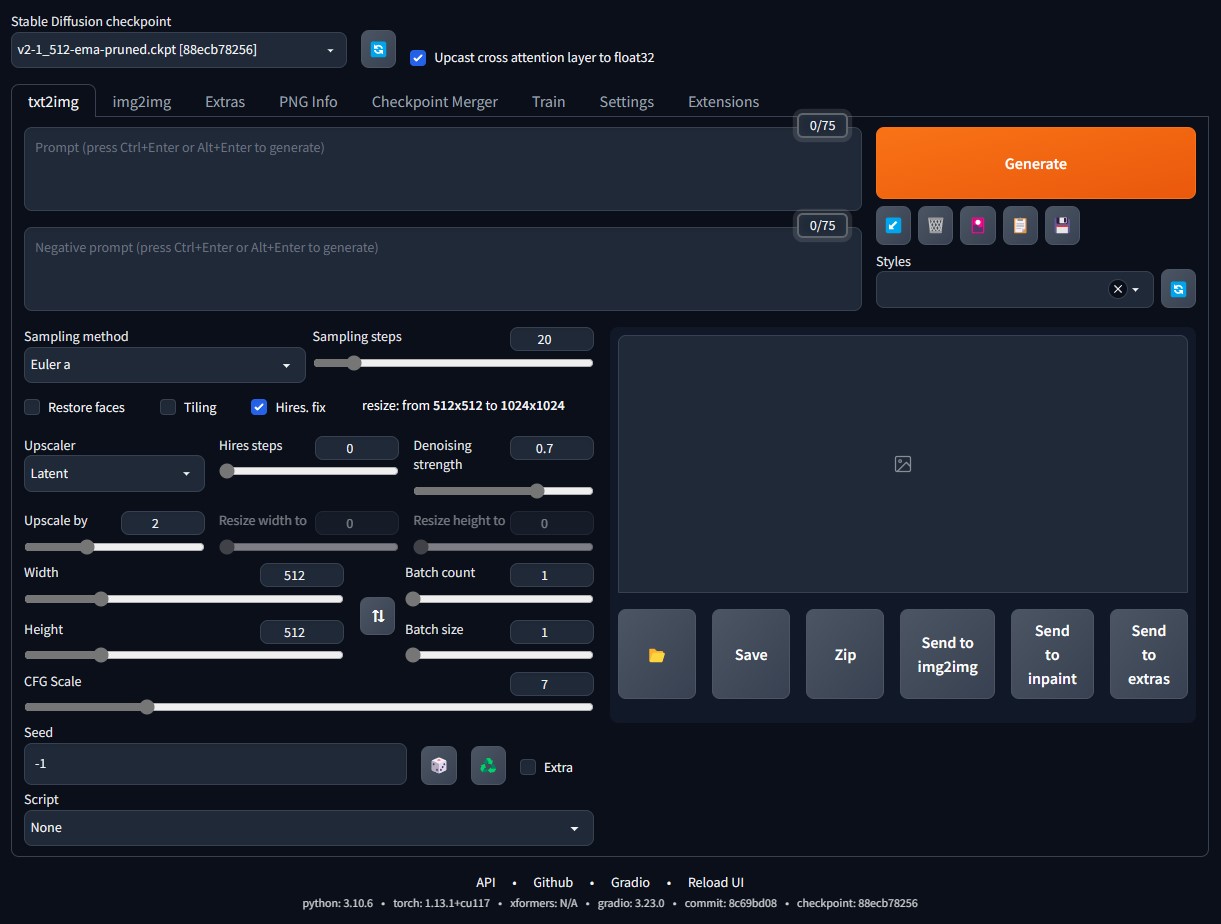

Để sử dụng Stable Diffusion và tạo ra hình ảnh từ sketch, bạn có thể làm theo các bước sau:

- Bước 1: Tải model và lora từ CivitAI về, mình chọn Meinamix_meinaV8 và Lora RaidenShogunRealistic và lưu vào thư mục tương ứng.

- Bước 2: Truy cập phần ControlNet, upload bản vẽ tay nhân vật mà bạn muốn AI tạo ra, sau đó chọn Model Canny hoặc Scribble để AI tạo ra hình từ sketch. Sau đó, bật Enable để kích hoạt ControlNet.

- Bước 3: Điều chỉnh tỷ lệ của ảnh tạo ra bằng hai thông số width và high sao cho tỉ lệ này trùng khớp với tỉ lệ của bản vẽ tay mà bạn nhập vào.

- Bước 4: Nhập lệnh Prompt, trong đó có hai loại prompt là Positive Prompt và Negative Prompt. Positive Prompt là thông tin về các yêu cầu, điều kiện mà bạn muốn AI tạo ra trong ảnh, còn Negative Prompt là các điều kiện mà bạn muốn AI hạn chế không tạo ra trong ảnh. Bạn có thể nhập các lệnh Prompt như sau:

Positive Prompt: beautiful girl, (modern), lighting,((beautiful face)), ((colorful clothes)), (ultra realistic, raw photo:1.2, 8k), (modern city background:1.2), ((blue hair))lora:raidenShogunRealistic_raidenshogunHandsfix:0.7

Negative Prompt: ((extra fingers, mutated hands)), ((poorly drawn hands)), ((poorly drawn face)), (((mutation))), (((deformed))), blurry, ((bad anatomy)), (((bad proportions))), ((extra limbs)), cloned face, (((disfigured))), ((missing arms)), ((missing legs)),(fused fingers), (too many fingers),ugly, tiling, cross-eye, body out of frame, blurry, bad art, bad anatomy, (((bad face)))

- Bước 5: Bấm nút Generate và chờ đợi kết quả. Nếu không hài lòng với kết quả, bạn có thể thay đổi chỉ số Sampling Methods và Batch Count để tùy chỉnh số lượng ảnh tạo ra.

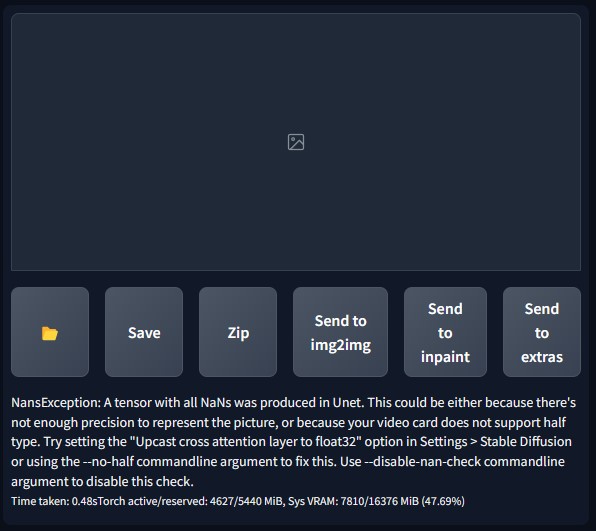

Một số lỗi thường gặp và cách khắc phục khi sử dụng Stable Diffusion tạo ảnh AI

1. Lỗi ảnh chân dung có hai đầu

Để tránh tình trạng ảnh tạo ra bị lỗi như có hai đầu người, bạn nên chọn kích thước ảnh là hình vuông (tỷ lệ 1:1), tốt nhất là 512×512.

2. Lệnh prompt “full body” bị bỏ qua.

Dù bạn đã dùng prompt là full boby nhưng ảnh tạo ra vẫn không có đủ toàn thân như mong muốn bạn có thể xử lý theo 2 cách sau:

- Mô tả thêm phần thân dưới, nên thêm vào câu nhắc prompt các từ: standing, long dress, legs, shoes.

- Chọn kích thước ảnh chiều cao lớn hơn chiều rộng.

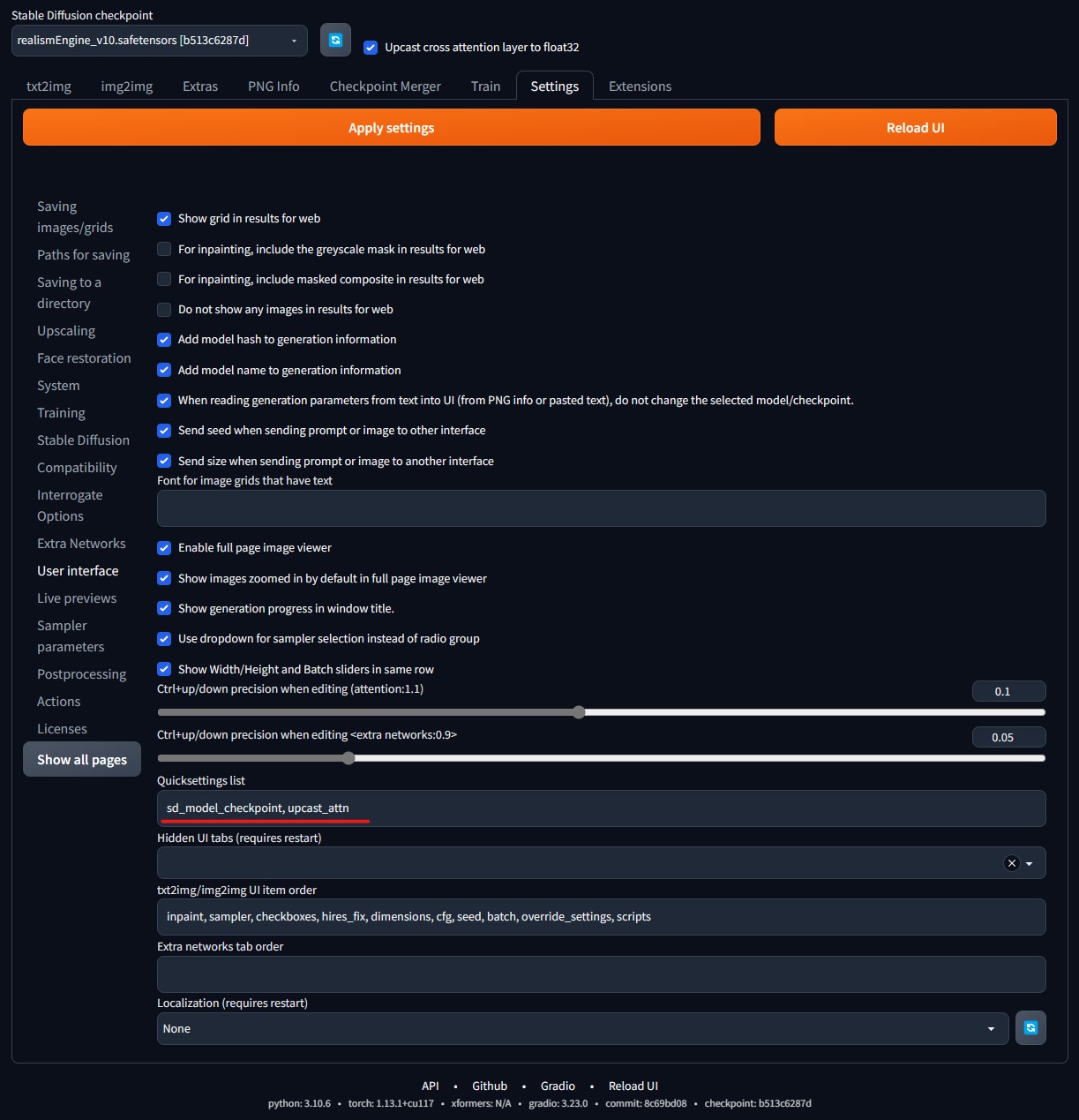

3. Xử lý lỗi xuất hiện ở phần khuôn mặt và đôi mắt.

Để khắc phục khuôn mặt và mắt bị biến dạng, không hoàn hảo bạn nên:

- Đánh dấu vào lựa chọn Resto Face.

- Nếu bản SD nào không có lựa chọn này có thể vào link CodeFormer upload ảnh lỗi lên để sửa mặt và mắt cho đẹp hơn.

4. Hình ảnh người mẫu lỗi với tay bị bóp méo, có quá nhiều hoặc quá ít ngón tay.

Stable Diffusion thường được cho là khó khăn trong phần xử lý ở phần bàn tay và ngón tay. Nếu gặp các lỗi ở phần tay, bạn nên thử theo 2 cách sau:

- Thêm các từ khóa mô tả bàn tay và ngón tay vào câu nhắc, điều này giúp AI nhận biết và xử lý bàn tay có chi tiết hơn. Ví dụ bạn có thể thêm “beautiful hands” và “detailed fingers” vào prompt.

- Cách khắc phục thứ hai là sử dụng inpainting. Tạo một mặt nạ trong khu vực có vấn đề. Sử dụng inpainting để tạo nhiều hình ảnh và chọn hình ảnh bạn thích.

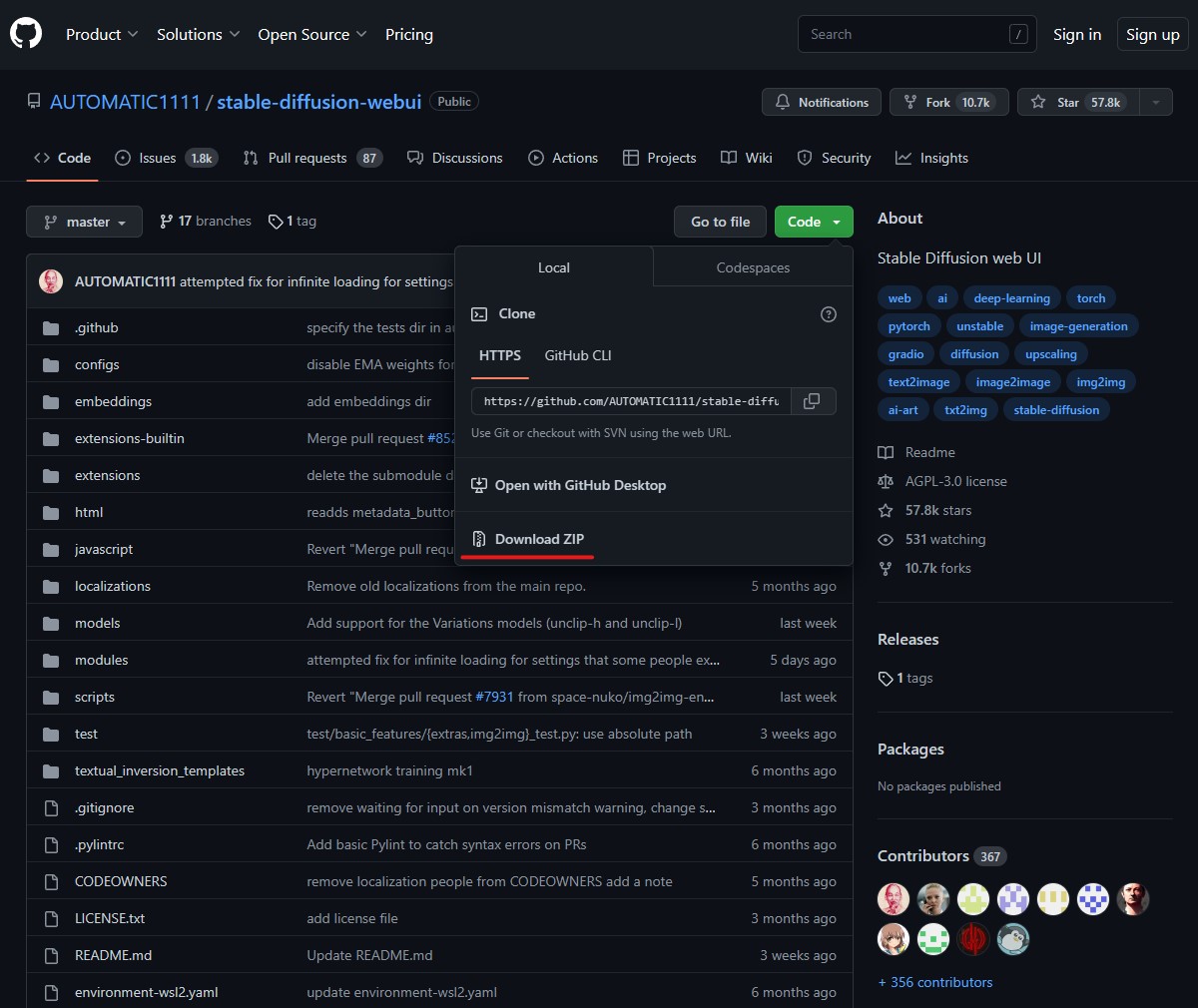

Thư viện model checkpoint sử dụng cho Stable Diffusion

Cộng đồng sử dụng Stable Diffusion đang phát triển nhanh chóng. Ngoài những model được training mặc định bạn cũng có thể tìm và tải các model checkpoint khác để chạy cho SD của mình. Sau khi tải về bạn để vào vào thư mục Models->Stable-diffusion là có thể sử dụng. Bạn có thể tìm thấy các hướng dẫn về cách sử dụng Stable Diffusion cũng như thư viện model, checkpoint, lora của SD được chia sẻ trên các hội nhóm và website. Dưới đây là vài website mà bạn có thể tham khảo khi mới bắt đầu:

- civitai.com

- Arthub.ai

- lexica.art

- stable-diffusion-art.com

- https://rentry.org/sdmodels

- https://github.com/Maks-s/sd-akashic

- mpost.io/best-100-stable-diffusion-prompts-the-most-beautiful-ai-text-to-image-prompts/

Câu hỏi thường gặp khi cài đặt và sử dụng Stable Diffusion

1. Stable Diffusion có hoạt động trên GPU AMD không?

Không. Stable Diffusion chỉ hoạt động trên GPU NVIDIA. Tuy nhiên, nếu máy tính của bạn đang dùng GPU AMD bạn có thể chạy bản NMKD Stable Diffusion GUI Portable này.

2. Stable Diffusion có miễn phí không?

Có. Stable Diffusion là mô hình mở vì vậy nó miễn phí, bạn có thể tải xuống và cài đặt trên bất kỳ máy tính cá nhân nào.

3. Stable Diffusion chạy được trên điện thoại không?

Không. Stable Diffusion là công cụ AI đòi hỏi phải có máy tính cấu hình trung bình với GPU NVIDIA từ 4GB mới có thể chạy được. Nếu máy tính của bạn cấu hình yếu, bạn có thể sử dụng phương án cài đặt Stable Diffusion thông qua dịch vụ Google Colad

Source: https://topchuyengia.vn/tin-tuc-hot/ai-stable-diffusion-ve-anh-nhan-vat-do-hoa